技术原理

PER-MADDPG核心改进

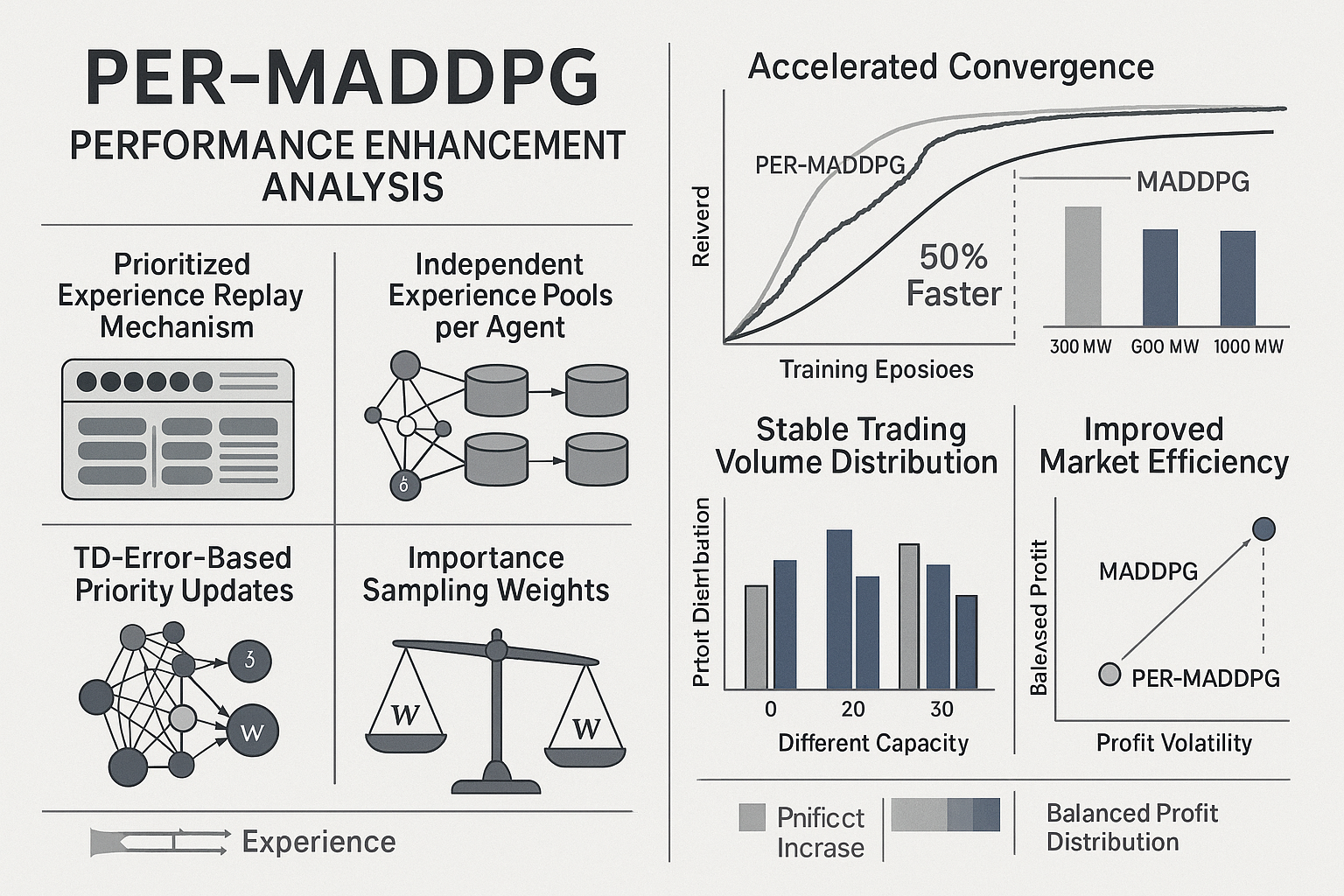

在原始MADDPG算法基础上,实现了四个关键改进:优先经验回放机制、独立经验池、TD误差优先级更新和重要性采样权重,显著提升了算法性能。

核心工作原理

PER-MADDPG算法通过智能化的经验选择机制,优先选择具有高TD误差的经验样本进行学习,同时为每个智能体建立独立的经验池,增强学习自主性。通过重要性采样权重维持学习稳定性,实现更高效的多智能体协调学习。

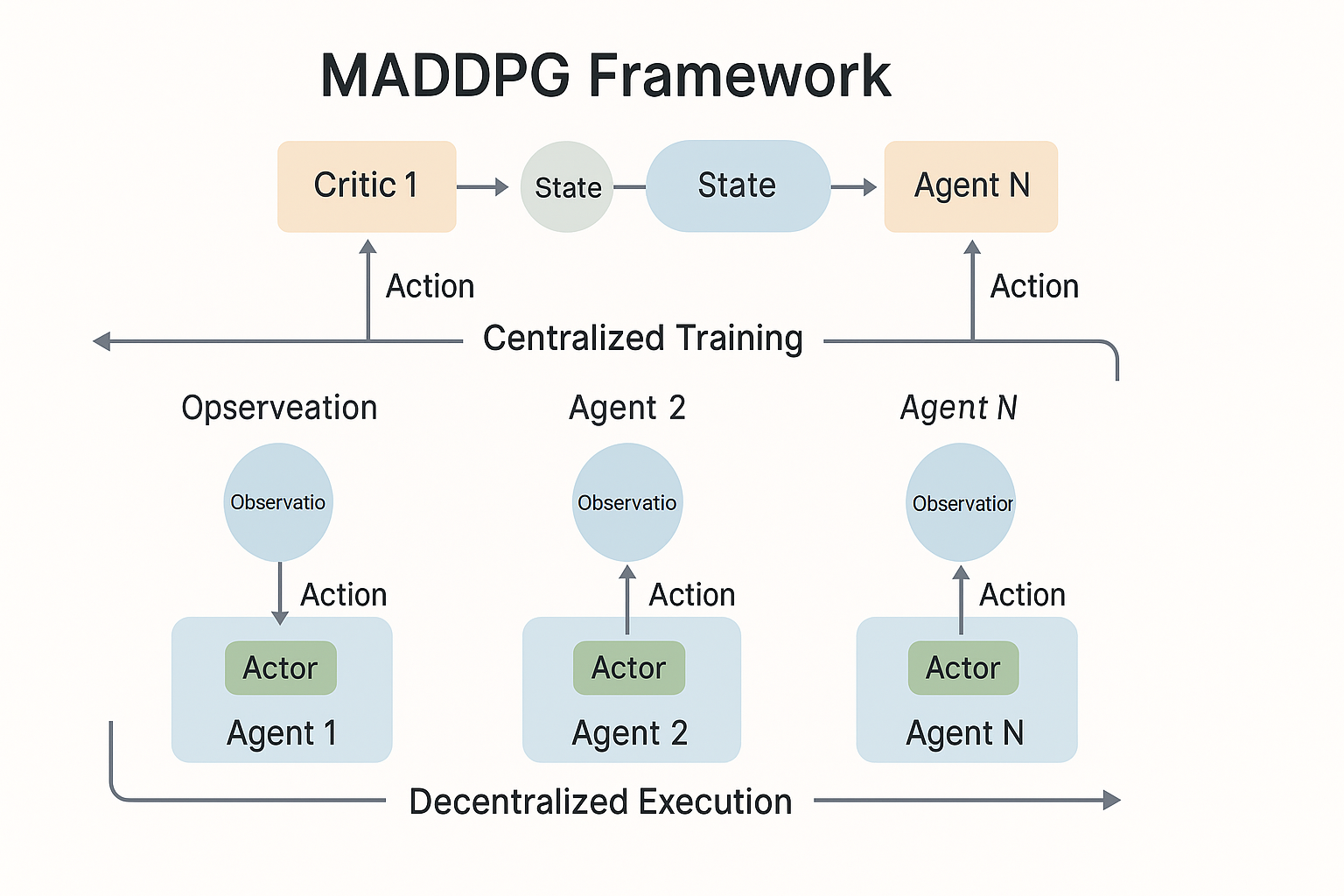

如图1所示,MADDPG算法采用Actor-Critic网络结构,每个智能体都有独立的策略网络和价值网络,通过集中式训练和分散式执行的方式实现多智能体协调。

技术架构设计

- 网络结构:Actor-Critic双网络架构,支持连续动作空间

- 经验回放:优先经验回放机制,智能选择高价值样本

- 多智能体协调:集中式训练,分散式执行策略

- 稳定性保障:重要性采样权重和独立经验池设计